Może słyszałeś lub nie o inżynierii promptów. W skrócie chodzi o „skuteczne komunikowanie się z AI, aby uzyskać to, czego chcesz”.

Większość ludzi nie wie, jak stworzyć dobre polecenia.

Jednakże, to staje się coraz bardziej istotną umiejętnością...

Ponieważ śmieci w = śmieci na wyjściu.

Oto najważniejsze techniki, które potrzebujesz do wywoływania reakcji 👇

Będę się odnosił do modelu językowego jako 'LM'.

Przykładami modeli językowych są ChatGPT od @OpenAI i Claude od @AnthropicAI.

1. Persona/rola pobudzająca

Przypisz rolę sztucznej inteligencji.

Przykład: "Jesteś ekspertem w dziedzinie X. Pomogłeś ludziom w realizacji Y przez 20 lat. Twoim zadaniem jest udzielić najlepszej porady na temat X.

Odpowiedz 'zrozumiałem', jeśli tak to rozumiesz."

Jednym z potężnych dodatków jest:

'Zawsze musisz zadawać pytania przed udzieleniem odpowiedzi, aby lepiej zrozumieć czego szuka pytający.'

Omówię to za chwilę, dlaczego jest to tak ważne.

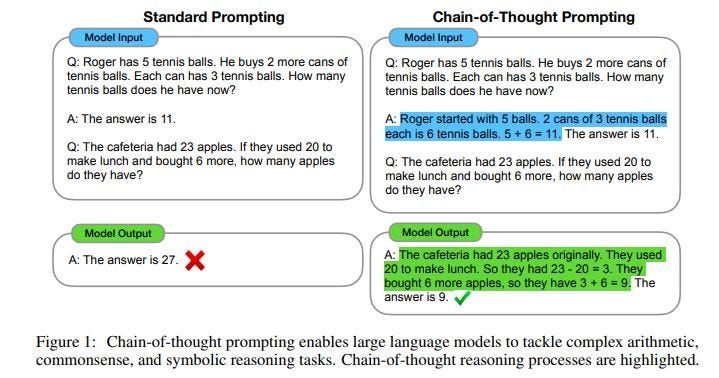

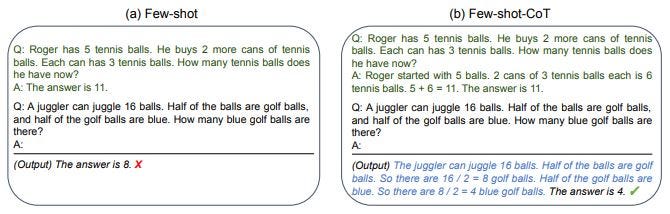

2. CoT

CoT oznacza "Chain of Thought"

Służy do polecenia LM, aby wyjaśnił swoje rozumowanie.

Przykład:

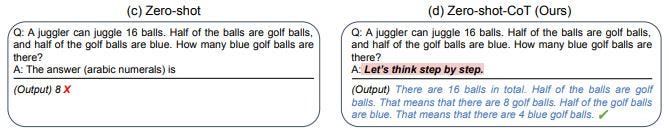

3. Bezpośrednie przetwarzanie

Zero-shot oznacza, że model dokonuje predykcji bez dodatkowego szkolenia na podstawie instrukcji.

Zajmę się podejściem few-shot za chwilę.

Zauważ, że zwykle CoT > Zero-shot-CoT

Przykład:

4. Kilka prób (i kilka prób CoT)

Przykładów nauczenia z minimalną ilością danych oznacza, że LM otrzymuje kilka przykładów w ramach podpowiedzi, aby szybciej przystosować się do nowych przykładów.

Przykład:

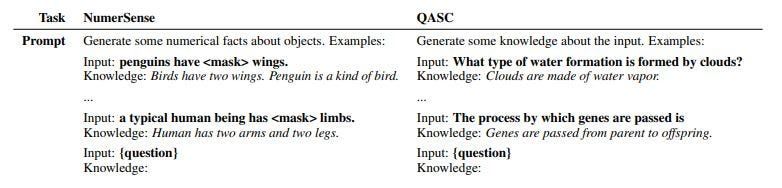

5. Generowanie wiedzy

Generowanie wiedzy związanej z pytaniem przez uruchomienie LM.

To można użyć do generowania podpowiedzi wiedzy (patrz dalej).

Przykład:

6. Generowane wiedza

Teraz, gdy posiadamy wiedzę, możemy podać te informacje do nowego polecenia i zadawać pytania związane z tą wiedzą.

Takie pytanie nazywa się "pytaniem ze wzmocnioną wiedzą".

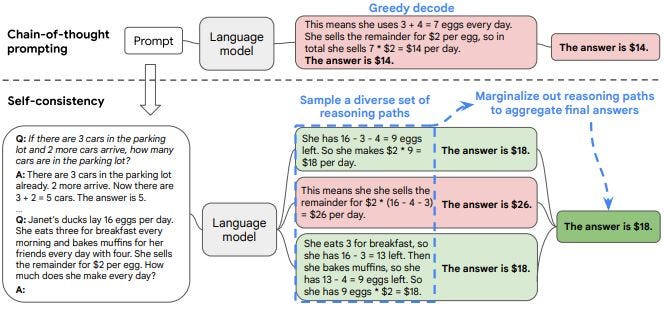

7. Samoistność

Ta technika jest używana do generowania wielu ścieżek myślowych (łańcuchów rozumowania).

Większościowa odpowiedź jest uznawana za ostateczną odpowiedź.

Przykład:

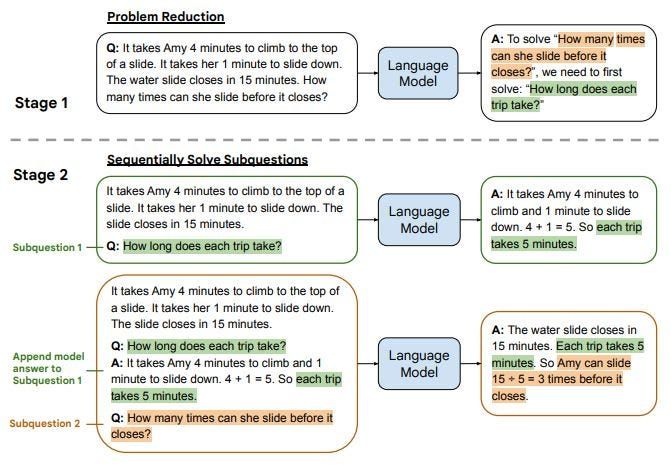

8. LtM

LtM oznacza "Najmniej do najwięcej"

Ta technika jest kontynuacją CoT. Dodatkowo, polega ona na podzieleniu problemu na podproblemy, a następnie rozwiązaniu ich.

Przykład: